Manus przynosi świt AGI, a bezpieczeństwo AI ponownie się zmieniło

Manus osiągnął wynik SOTA (State-of-the-Art) w teście porównawczym GAIA, pokazując, że jego wydajność przewyższa wyniki modeli wielkoskalowych Open AI na tym samym poziomie. Innymi słowy, może samodzielnie wykonywać złożone zadania, takie jak transgraniczne negocjacje biznesowe, które obejmują rozkładanie warunków umowy, przewidywanie strategii, generowanie rozwiązań, a nawet koordynowanie zespołów prawnych i finansowych. W porównaniu z tradycyjnymi systemami, Manus ma zalety dynamicznego demontażu obiektów, rozumowania międzymodalnego i uczenia się wspomaganego pamięcią. Może dzielić duże zadania na setki wykonywalnych podzadań, przetwarzać wiele typów danych w tym samym czasie i wykorzystywać uczenie się przez wzmacnianie, aby stale poprawiać efektywność podejmowania decyzji i zmniejszać liczbę błędów.

Oprócz zachwytu nad szybkim rozwojem technologii, Manus po raz kolejny wywołał spór w kręgu na ścieżce ewolucji AI: czy AGI zdominuje świat w przyszłości, czy też MAS będzie dominować synergicznie?

Zaczyna się to od filozofii projektowania Manus, która zakłada dwie możliwości:

Jedną z nich jest ścieżka AGI. Poprzez ciągłe doskonalenie poziomu inteligencji indywidualnej, jest ona bliska wszechstronnej zdolności podejmowania decyzji przez istoty ludzkie.

Istnieje również ścieżka MAS. Jako superkoordynator dowódź tysiącami pionowych agentów do współpracy.

Na pierwszy rzut oka dyskutujemy o różnych ścieżkach, ale w rzeczywistości dyskutujemy o podstawowej sprzeczności rozwoju sztucznej inteligencji: jak zrównoważyć wydajność i bezpieczeństwo? Im bardziej monolityczna inteligencja jest bliższa AGI, tym większe ryzyko podejmowania decyzji przez czarną skrzynkę. Jednak chociaż współpraca wielu agentów może zdywersyfikować ryzyko, może przegapić kluczowe okna decyzyjne z powodu opóźnień w komunikacji.

Ewolucja Manus niewidocznie zwiększyła nieodłączne ryzyko związane z rozwojem sztucznej inteligencji. Na przykład czarne w prywatności danych: w scenariuszach medycznych Manus potrzebuje dostępu w czasie rzeczywistym do danych genomicznych pacjenta; W trakcie negocjacji finansowych może dotknąć niejawnych informacji finansowych spółki; Na przykład pułapka uprzedzeń algorytmicznych, w której Manus udziela rekomendacji płacowych poniżej średniej kandydatom o określonym pochodzeniu etnicznym w negocjacjach dotyczących zatrudnienia; Prawie połowa warunków w rozwijających się branżach jest błędnie oceniana podczas przeglądu umów prawnych. Innym przykładem jest podatność na atak przeciwstawny, w której haker wszczepił określoną częstotliwość głosu, aby Manus źle ocenił zakres oferty przeciwnika podczas negocjacji.

Musimy zmierzyć się ze straszliwym problemem systemów sztucznej inteligencji: im inteligentniejszy system, tym szersza powierzchnia ataku.

Jednak bezpieczeństwo to słowo, które jest stale wymieniane w web3, a różne metody szyfrowania zostały wyprowadzone z ram niemożliwego trójkąta V Boga (sieci blockchain nie mogą jednocześnie osiągnąć bezpieczeństwa, decentralizacji i skalowalności):

-

Model zabezpieczeń Zero Trust: Podstawową ideą modelu bezpieczeństwa Zero Trust jest "nie ufaj nikomu, zawsze weryfikuj", co oznacza, że urządzeniom nie należy domyślnie ufać, niezależnie od tego, czy znajdują się w sieci wewnętrznej, czy nie. Model ten kładzie nacisk na ścisłe uwierzytelnianie i autoryzację dla każdego żądania dostępu w celu zapewnienia bezpieczeństwa systemu.

-

Zdecentralizowana tożsamość (DID): DID to zestaw standardów identyfikatorów, które umożliwiają identyfikację podmiotów w sposób weryfikowalny i trwały bez potrzeby posiadania scentralizowanego rejestru. Umożliwia to nowy model zdecentralizowanej tożsamości cyfrowej, często porównywany do tożsamości autonomicznej, i jest ważną częścią Web3.

-

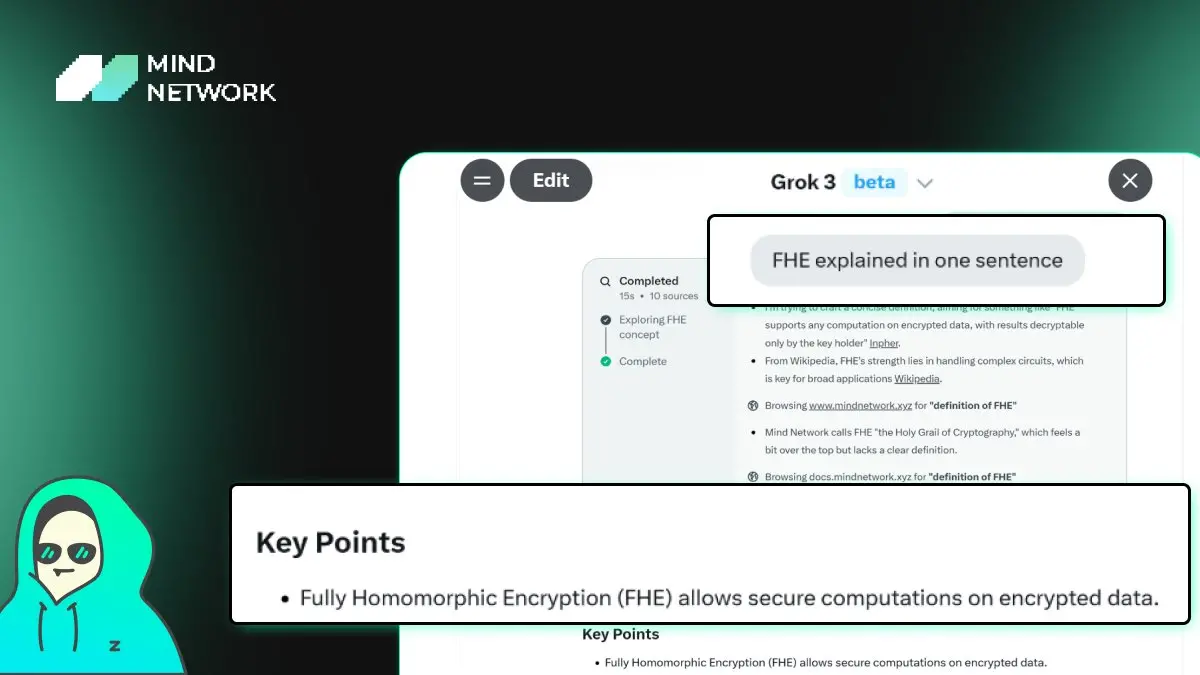

W pełni homomorficzne szyfrowanie (FHE): to zaawansowana technologia szyfrowania, która umożliwia wykonywanie dowolnych obliczeń na zaszyfrowanych danych bez ich odszyfrowywania. Oznacza to, że osoba trzecia może wykonywać operacje na zaszyfrowanym tekście, a wynik uzyskany po odszyfrowaniu jest taki sam, jak wynik tej samej operacji na tekście jawnym. Ta funkcja jest ważna w przypadku scenariuszy, które wymagają obliczeń bez ujawniania nieprzetworzonych danych, takich jak przetwarzanie w chmurze i outsourcing danych.

Model bezpieczeństwa typu "zero zaufania" i DID miały pewną liczbę projektów w wielu rundach hossy i albo odniosły sukces, albo utonęły na fali szyfrowania, a jako najmłodsza metoda szyfrowania: w pełni homomorficzne szyfrowanie (FHE) jest również wielkim zabójcą w rozwiązywaniu problemów bezpieczeństwa w erze sztucznej inteligencji. W pełni homomorficzne szyfrowanie (FHE) to technologia, która umożliwia wykonywanie obliczeń na zaszyfrowanych danych.

Jak to naprawić?

Po pierwsze, poziom danych. Wszystkie informacje wprowadzane przez użytkownika (w tym dane biometryczne, ton głosu) są przetwarzane w stanie zaszyfrowanym i nawet sam Manus nie jest w stanie odszyfrować oryginalnych danych. Na przykład w przypadku diagnozy medycznej dane genomowe pacjenta są analizowane w szyfrogramie przez cały proces, aby uniknąć wycieku informacji biologicznych.

Poziom algorytmiczny. "Trenowanie modelu kryptograficznego" realizowane przez FHE uniemożliwia programistom wgląd w ścieżkę decyzyjną AI.

Na poziomie synergii. Szyfrowanie progowe jest używane do komunikacji z wieloma agentami, a pojedynczy węzeł nie zostanie naruszony bez spowodowania globalnego wycieku danych. Nawet w przypadku ataków i obrony łańcucha dostaw osoby atakujące nie mogą uzyskać pełnego obrazu firmy po infiltracji wielu agentów.

Ze względu na ograniczenia techniczne, bezpieczeństwo web3 może nie być bezpośrednio związane z większością użytkowników, ale jest nierozerwalnie związane z pośrednimi interesami, a w tym ciemnym lesie, jeśli nie zrobisz wszystkiego, co w Twojej mocy, aby się uzbroić, nigdy nie uciekniesz od tożsamości "porów".

uPort został uruchomiony w sieci głównej Ethereum w 2017 roku i był prawdopodobnie pierwszym projektem zdecentralizowanej tożsamości (DID), który został wydany w sieci głównej.

Jeśli chodzi o model bezpieczeństwa typu zero trust, NKN udostępnił swoją sieć główną w 2019 roku.

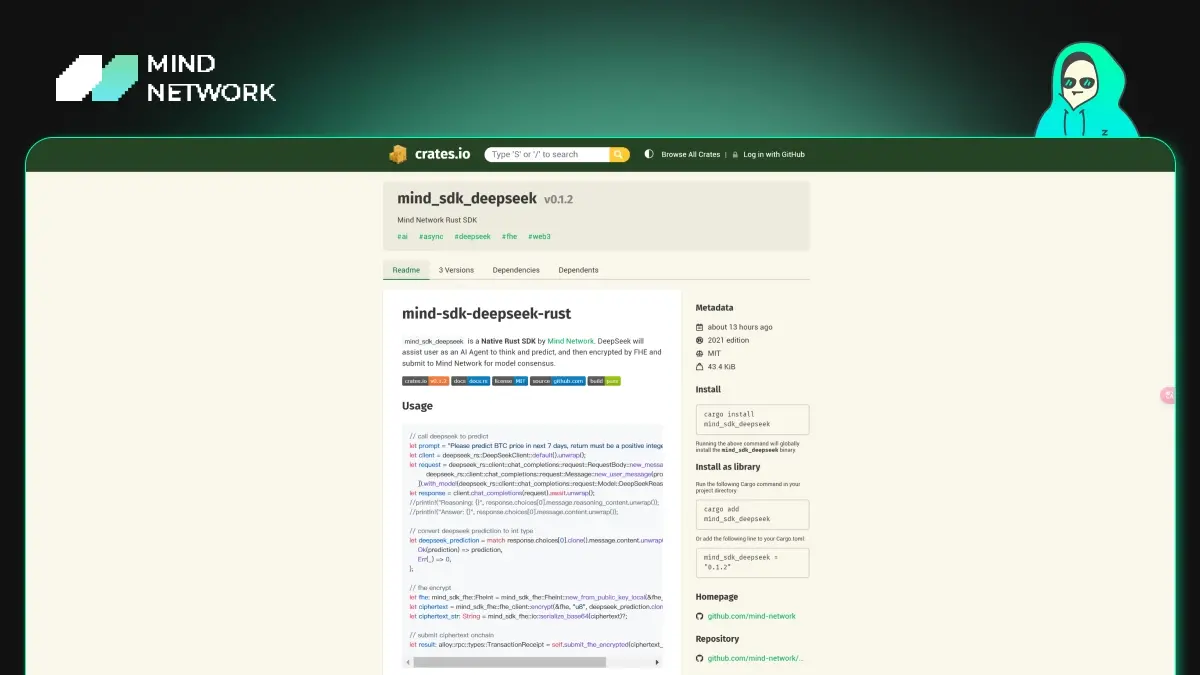

Mind Network jest pierwszym projektem FHE, który został uruchomiony w sieci głównej i objął prowadzenie we współpracy z ZAMA, Google, DeepSeek itp.

uPort i NKN to już projekty, o których nigdy nie słyszałem i wygląda na to, że projekty bezpieczeństwa naprawdę nie są zainteresowane spekulantami, więc poczekajmy i zobaczmy, czy sieć Mind może uniknąć tej klątwy i stać się liderem w dziedzinie bezpieczeństwa.

Przyszłość jest tutaj. Im bardziej sztuczna inteligencja jest bliższa ludzkiej inteligencji, tym bardziej potrzebuje systemów obronnych, które nie są ludzkie. Wartość bezpieczeństwa informacji w sieci polega nie tylko na rozwiązywaniu bieżących problemów, ale także na torowaniu drogi do ery silnej sztucznej inteligencji. Na tej stromej drodze do AGI cyberbezpieczeństwo nie jest opcją, ale koniecznością, aby przetrwać.